Les chiffres que ton outil de suivi position SEO t’affiche ce matin ne sont pas forcément faux — mais ils ne disent pas non plus toute la vérité. C’est là que ça se complique. Entre la personnalisation des résultats, les différences de cache entre plateformes et les enrichissements SERP qui repoussent les résultats organiques vers le bas, lire correctement ses positions est devenu un exercice de décodage autant que de collecte. Je ne dis pas que ces outils sont inutiles. Je dis qu’ils mesurent une réalité partielle, dans un environnement mouvant, à un instant T. Et que si tu confonds l’instrument avec la vérité, tu vas passer ton temps à réagir à du bruit.

Pourquoi tes positions bougent chaque jour

Ouvrir son tableau de bord le matin et voir un mot-clé perdre quatre places sans raison apparente — ça arrive. Ça ne signifie pas grand-chose pour autant.

Google ajuste ses algorithmes en continu. Un core update, un test temporaire de format SERP, une pondération légèrement modifiée sur un signal : le classement d’une page peut varier sans que tu aies touché quoi que ce soit. À ça s’ajoute la personnalisation : localisation géographique, device, historique de navigation. Un même mot-clé peut s’afficher à deux positions différentes selon qu’on le cherche depuis Lyon ou Paris, sur mobile ou desktop.

Google décide.

Point.

Tu peux rien forcer.

Les outils de suivi rajoutent leur propre couche d’incertitude. SEMrush, Ahrefs et Google Search Console n’interrogent pas les mêmes serveurs au même moment. Leurs proxies, leurs bases de cache et leurs fréquences de mise à jour diffèrent. Voir un écart de deux à trois positions entre deux plateformes sur la même requête est parfaitement normal — ce n’est pas un bug, c’est une limite structurelle.

La saisonnalité fait le reste. Certaines requêtes montent mécaniquement autour du Black Friday ou des soldes, puis retombent. D’autres sont quasi-inertes sur plusieurs semaines. Interpréter chaque variation comme un signal fort, c’est courir après des ombres.

Suivi manuel vs plateforme : où tu perds vraiment du temps

Même en comprenant les limites des outils, beaucoup continuent à suivre leurs positions à la main. Et là, un autre problème entre en jeu.

Saisir ses requêtes dans Google en navigation privée, changer de localisation via VPN, noter les résultats dans un tableur — c’est tentant quand le budget est serré. Mais la navigation privée ne neutralise pas tous les signaux personnalisants. Ton IP, la langue du navigateur, la localisation déduite : tout ça continue d’influencer la SERP retournée. Ce que tu lis n’est pas la position « neutre ». C’est une position parmi d’autres.

Et à mesure que le nombre de mots-clés à suivre grossit — 30, 50, 100 — la méthode s’effondre. Oublis, erreurs de saisie, impossibilité d’historiser proprement les données, lecture biaisée par la présence d’annonces ou de People Also Ask qui décalent les résultats organiques. Le suivi manuel ne permet pas de tendance fiable. Il donne une impression de contrôle, pas un signal exploitable.

La question n’est pas « manuel ou outil ? », c’est « à partir de quel seuil l’outil devient incontournable ? » Pour 5 à 10 requêtes stratégiques et un budget quasi-nul, le manuel peut tenir — à condition d’accepter l’approximation. Dès que tu gères plusieurs dizaines de mots-clés, plusieurs sites ou des rapports réguliers pour des clients ou de la direction, l’automatisation n’est plus un luxe.

Quel outil choisir sans te ruiner

Choisir son outil de suivi, c’est avant tout estimer honnêtement ce dont tu as réellement besoin — pas ce que la page de pricing d’une suite enterprise te fait croire être indispensable.

Les solutions gratuites ont un vrai usage. Google Search Console reste la référence de base : jusqu’à 16 mois d’historique, données directement issues de Google, intégration native avec les autres outils Search. Ses limites sont connues : positions moyennées sur l’ensemble des impressions, pas de segmentation fine par ville ou device, zéro analyse concurrentielle. Des outils comme SERPROBOT ou WhatsMySerp complètent ponctuellement, mais avec des volumes limités et une rétention courte.

Les outils payants s’imposent dès que tu dois industrialiser le monitoring. Voici où ça se situe concrètement :

| Critère | Gratuit (GSC) | Mid-market (SE Ranking) | Enterprise (SEMrush, Ahrefs) |

|---|---|---|---|

| Mots-clés suivis | <50 | 100 à 1 000 | 2 000+ |

| Historique | 3 à 16 mois | 12 à 36 mois | 36+ mois |

| Localisation | Pays/ville limité | Ville, région, international | Multi-pays, granularité fine |

| Suivi concurrentiel | Non | Oui | Oui + insights avancés |

| Prix mensuel | 0 € | 20–50 € | 100 €+ |

Le vrai critère de choix n’est pas le nom de l’outil. C’est le rapport entre la précision dont tu as besoin et le coût que tu peux justifier sur ton volume d’activité.

Sur-investir dans une suite enterprise pour suivre 15 mots-clés, c’est une perte sèche. Rester sur du gratuit quand tu pilotes 200 mots-clés segmentés sur trois zones géographiques, c’est de l’aveuglement volontaire.

Les erreurs d’interprétation qui coûtent cher

Avoir les bons chiffres ne suffit pas si tu les lis mal. Et les pièges d’interprétation sont nombreux, même chez des gens qui font du SEO depuis longtemps.

La position moyenne n’est pas la position réelle. C’est l’erreur la plus fréquente avec Search Console. La « position moyenne » dilue des contextes très différents : ta page peut ressortir en 2e position pour 30% des requêtes, et en 12e pour les autres. La moyenne t’affiche 6. Tu crois progresser, alors que tu as surtout perdu en cohérence de classement.

Ensuite, il y a les changements de SERP que personne ne regarde. Une page peut conserver sa position organique nominale tout en devenant beaucoup moins visible — parce qu’un featured snippet, un carrousel vidéo ou un bloc People Also Ask s’est intercalé au-dessus. La position change pas. La visibilité réelle, si.

Un client avait « perdu » cinq positions sur sa requête principale un lundi matin. En regardant la SERP, on a vu qu’un encart local avec carte était apparu le week-end précédent. Pas de sanction. Pas de problème technique. Juste un enrichissement SERP qu’aucun outil n’avait signalé.

Autre erreur classique : attribuer toute chute à une sanction algorithmique ou un problème technique, et modifier la structure du site en urgence. Souvent, c’est un nouveau concurrent entrant, une évolution locale, ou simplement du bruit saisonnier.

La géographie introduit un dernier biais souvent ignoré. Une progression sur Paris peut masquer une contre-performance à Lyon. Un bon positionnement local disparaît dans un suivi national. Sans segmentation géographique, tu pilotes à l’aveugle.

Configurer un suivi qui te sert vraiment

Un tableau de positions qui ne débouche sur aucune décision, c’est juste du stockage de données.

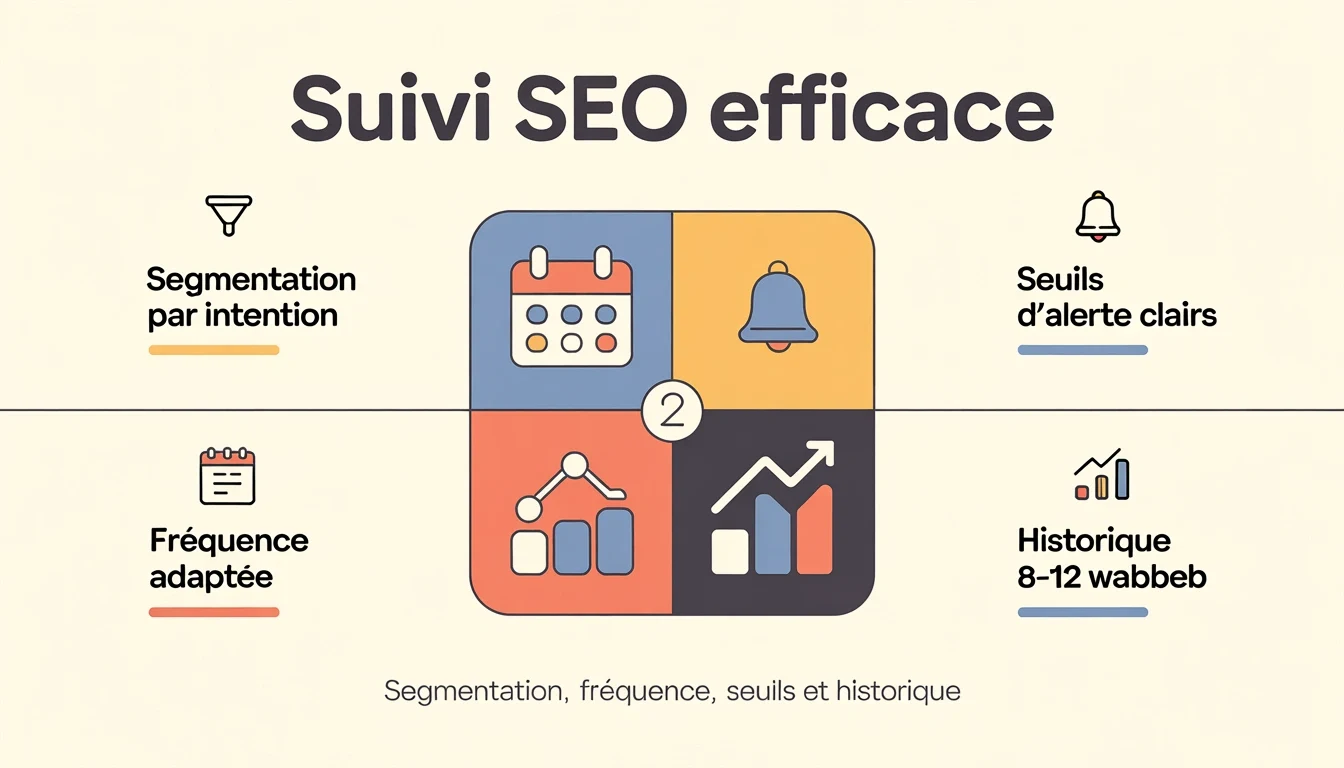

La première règle, c’est la segmentation. Tous tes mots-clés n’ont pas la même valeur ni la même urgence. Groupe-les par intention (informationnelle, transactionnelle, navigationnelle), par étape dans le tunnel, par niveau de compétitivité. Un mot-clé de fond de tunnel mérite un suivi hebdomadaire. Une requête générique à faible volume peut attendre un relevé mensuel.

La fréquence, ensuite. Mesurer quotidiennement l’ensemble de ses positions n’a de sens que pour des sites très volatils ou à forts enjeux business. Pour la majorité des cas, un relevé hebdomadaire sur les requêtes cœur et mensuel sur le reste donne le meilleur rapport signal/bruit.

Configure des seuils d’alerte clairs plutôt que de surveiller chaque micro-variation :

- Perte de 3 positions ou plus sur un mot-clé prioritaire pendant trois semaines consécutives

- Disparition d’une URL clé sur une requête à fort trafic

- Gain de 10 places sur une requête stratégique

Enfin, il te faut au minimum 8 à 12 semaines d’historique pour lire une tendance fiable. Toute optimisation testée doit être corrélée à la courbe sur cette période. Sinon, tu confonds saisonnalité, bruit de SERP et effet réel de tes actions.

Conclusion

Le suivi de position a une seule utilité réelle : guider tes décisions. Pas satisfaire ton besoin de contrôle.

J’ai vu des équipes passer des heures à commenter des variations de deux positions sur des requêtes à 50 recherches par mois. J’ai vu des audits complets déclenchés sur des baisses qui n’étaient que du bruit saisonnier. Le problème n’était pas l’outil. C’était la lecture.

Configure un suivi segmenté, choisis une fréquence adaptée à ta réalité, et fixe des seuils d’alerte qui correspondent à tes vrais leviers. Regarde toujours la SERP avant de conclure à une sanction. Et méfie-toi des moyennes : elles lissent exactement ce que tu aurais besoin de voir.

Un bon suivi de position, ça ne te donne pas la certitude. Ça te donne de meilleures questions.

FAQ

Dois-je tracker mes positions tous les jours ou une fois par semaine ?

Ça dépend de ton secteur et de tes enjeux. Pour un site d’actualités ou un e-commerce compétitif, le quotidien se justifie. Dans la majorité des cas, l’hebdomadaire offre le meilleur équilibre entre signal utile et charge de travail.

Pourquoi mes positions diffèrent entre mobile et desktop ?

Google adapte ses résultats au device : performances techniques, formats de contenu, parfois tests spécifiques à la SERP mobile. Suis tes positions séparément par device. Un outil payant le fait nativement ; c’est l’un des rares cas où la segmentation change vraiment l’interprétation.

Comment distinguer suivi de position et données Analytics sans croiser les mauvaises lectures ?

Le suivi de position mesure le classement de tes pages pour des requêtes précises. Analytics mesure le flux réel d’utilisateurs, toutes sources confondues. Une hausse de position n’entraîne pas automatiquement une hausse de trafic — et inversement. Utilise chaque donnée pour ce qu’elle mesure réellement, pas pour valider ce que tu espères voir.