La plupart des rapports SEO finissent dans une corbeille, symbolique ou réelle. Pas parce que le travail est mauvais. Parce que les données arrivent sans contexte, sans hiérarchie, sans lien avec ce qui compte vraiment pour le client. J’ai vu des consultants sérieux perdre des comptes non pas sur leurs résultats, mais sur leur incapacité à les rendre lisibles. Un rapport mal construit ne fait pas que rater sa cible : il génère de la méfiance, des attentes déformées, parfois des décisions qui vont à l’encontre de la stratégie. À l’inverse, un rapport bien structuré — aligné sur les enjeux métier, adapté à l’interlocuteur — devient un vrai outil de pilotage. Pas un document de plus. Un levier.

Pourquoi un rapport standard échoue avec vos clients

Le problème n’est pas le manque de données. C’est justement ça, le problème.

Un rapport classique, c’est souvent une exportation brute : des courbes, des volumes, des positions, des listes de mots-clés. Le tout déversé sans filtre, sans récit, sans réponse à la question que le décideur se pose en ouvrant le document. Et cette question est simple : « Est-ce qu’on avance ? »

Le premier écueil, c’est la prolifération de métriques vanity. Volume total de visites, nombre de backlinks, score d’autorité global. Ces chiffres fascinent, donnent une illusion de contrôle, et ne provoquent aucune décision.

Aucune.

Le deuxième écueil, c’est le décrochage entre données SEO et réalité business. Une hausse de positions sur un mot-clé transactionnel peut valoir plus qu’une hausse de trafic de 20 % sur des pages informatives faibles. Si le rapport ne fait pas ce lien, le client ne le fera pas non plus.

Troisième problème, et le plus sous-estimé : l’absence d’adaptation au contexte. Un e-commerçant en plein pic de saisonnalité et un réseau B2B en phase de refonte n’ont pas les mêmes urgences. Un rapport générique ne parle à personne. Il est lu en diagonale, puis archivé.

Ce que tu dois vraiment mesurer pour piloter

Tout découle de là — une fois qu’on a compris pourquoi le rapport standard ne fonctionne pas, la question des métriques devient plus simple à trancher.

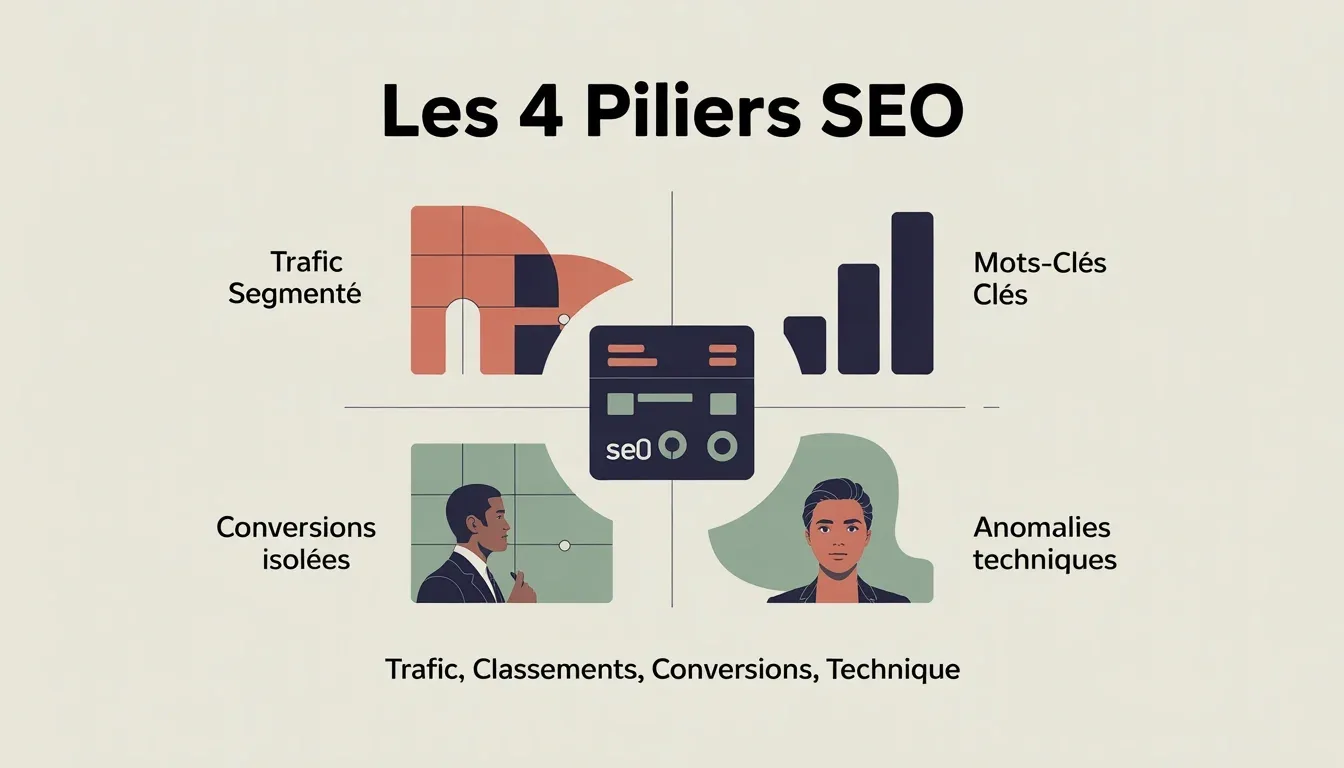

La tendance du trafic organique reste le point de départ, mais pas dans sa forme globale. Il faut la décomposer : par type d’appareil, par segment de pages, par pays si le site est multi-marché. Une hausse globale peut masquer un effondrement sur les pages qui génèrent des leads. C’est ce niveau de lecture qui fait la différence.

Les classements sur les mots-clés stratégiques viennent ensuite. Pas la position moyenne tous termes confondus — c’est une métrique vanity comme une autre. Ce qui compte, c’est la volatilité sur les termes transactionnels en page 1, et les signaux d’alerte qui demandent une réponse immédiate.

Les conversions organiques doivent être isolées. Une hausse de trafic sans progression des conversions, c’est le signe classique d’une stratégie qui attire le mauvais public. Ça se voit dans les chiffres. Souvent trop tard.

La couverture d’indexation et les Core Web Vitals ferment le tableau de bord minimal. Pas le nombre total d’URLs indexées — les anomalies : nouvelles exclusions, erreurs de crawl récurrentes, dégradations sur mobile.

Vanity metrics vs métriques actionnables

| Type | Exemple | Utilité réelle |

|---|---|---|

| Vanity | Volume total de backlinks | Faible, sauf variation majeure |

| Actionnable | Taux de conversion organique | Directement lié au chiffre d’affaires |

| Vanity | Position moyenne tous mots-clés | Masque les poches critiques |

| Actionnable | Chute sur les top 10 stratégiques | Signal d’alerte à traiter maintenant |

| Vanity | Nombre brut de pages indexées | Nécessite contexte pour être utile |

| Actionnable | Nouvelles pages exclues | Agir pour rétablir la couverture |

Le reste n’alimente que la distraction.

Adapter la structure selon qui va lire

Savoir quoi mesurer, c’est une chose. Savoir pour qui tu écris, c’est ce qui rend le rapport réellement utile.

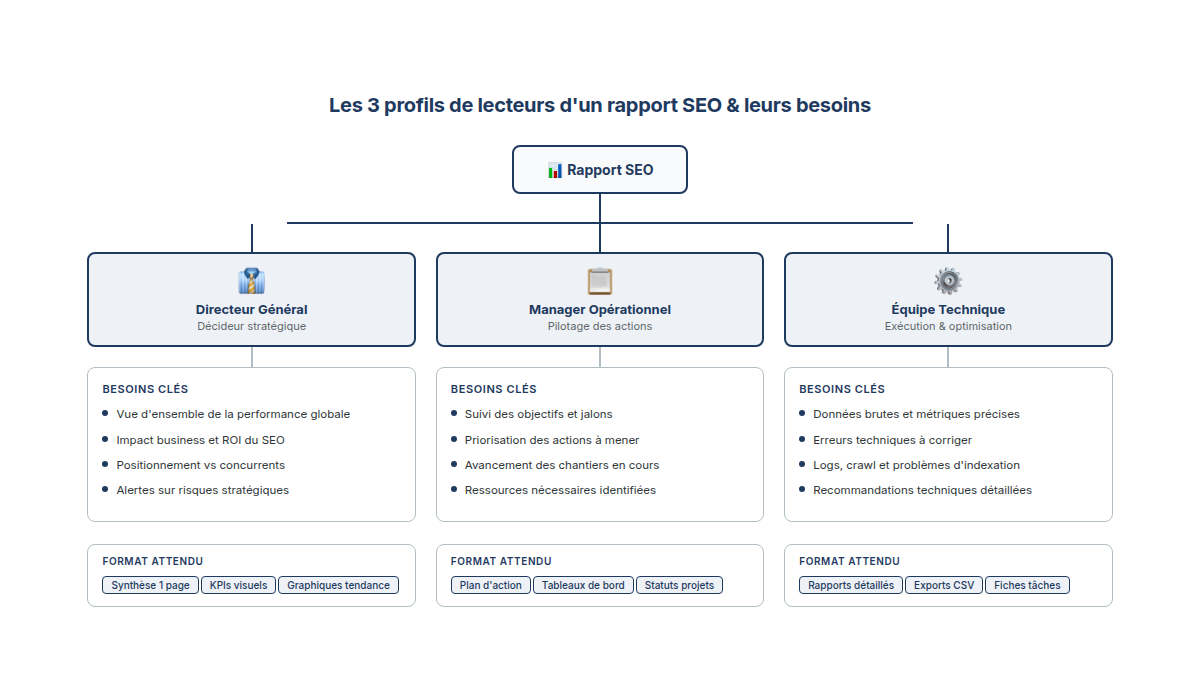

Un directeur général n’ouvre pas un rapport pour lire des métriques techniques. Il veut savoir si le SEO rapporte, si un risque se profile, et ce qui se passe ensuite. Une synthèse, un chiffre clé, une alerte, une décision à prendre. C’est tout ce dont il a besoin.

Un manager opérationnel, lui, cherche le détail des actions en cours, les blocages, les recommandations à court terme. Il veut comprendre ce qui avance et ce qui coince.

L’équipe technique attend autre chose encore : couverture d’indexation granulaire, erreurs de crawl précises, état des Core Web Vitals par page, priorisation des bugs. Pas de langue de bois. Pas d’euphémisme. Des faits et des responsabilités claires.

Ignorer cette réalité produit deux échecs symétriques. Trop technique pour le décideur : rapport ignoré. Trop synthétique pour l’équipe : rapport inutilisable. Un bon rapport propose plusieurs niveaux de lecture sans se diluer.

Une synthèse en ouverture, une annexe technique en bas. Simple, mais rarement fait.

Construire un rapport qui force l’action

Adapter la structure à l’audience ne suffit pas si le rapport reste descriptif.

La différence entre un rapport qu’on lit et un rapport qui déclenche quelque chose, elle tient à un seul principe : chaque donnée doit mener à une décision. Pas à une observation. Une décision.

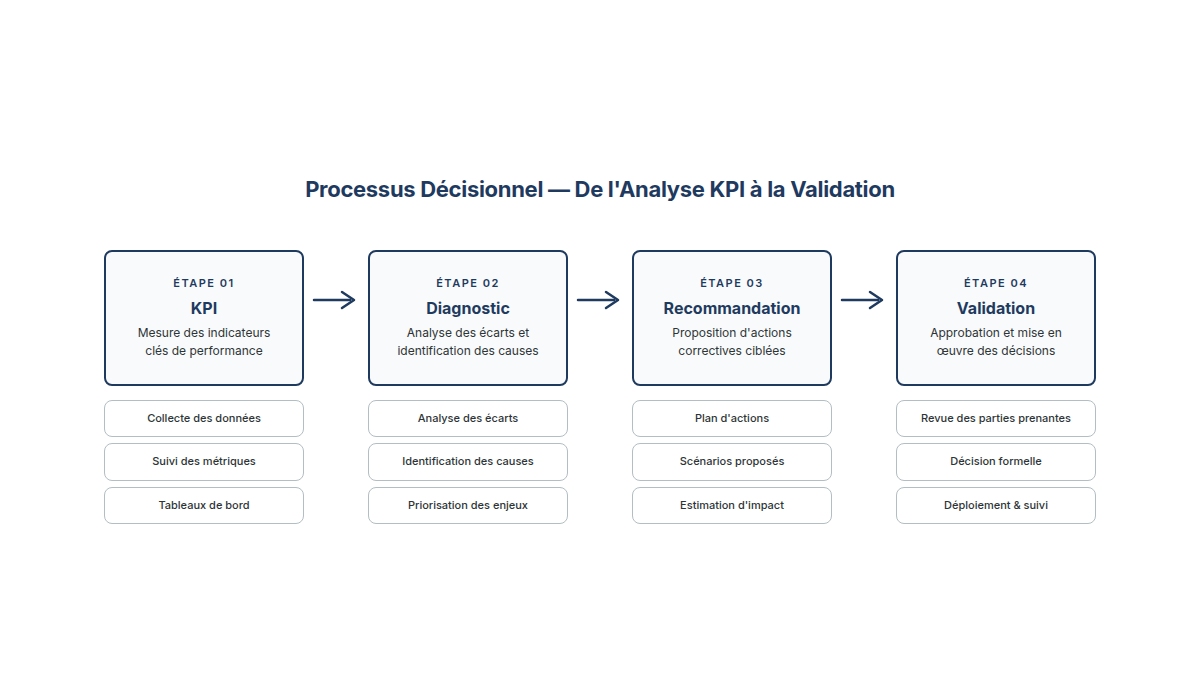

Ça commence par un résumé exécutif en ouverture. Trois questions, trois réponses : est-on sur la bonne trajectoire ? Un risque menace-t-il la croissance ? Quelles actions s’imposent dans les prochaines semaines ? Ce résumé doit arriver avant les graphiques, pas après.

Les alertes viennent ensuite. Une chute de CTR sur une page stratégique, un bug d’indexation, une volatilité forte sur un mot-clé commercial. Chaque alerte = une explication courte + une recommandation concrète.

Le schéma qui fonctionne : KPI → Diagnostic → Recommandation → Validation attendue.

Pas de storytelling creux. Pas de padding. Et chaque section se clôture par un call-to-action explicite : validation d’une recommandation, ouverture d’un ticket, arbitrage budgétaire. Le client sait ce qu’on attend de lui.

C’est ce qui sépare un rapport passif d’un outil de pilotage.

Les outils qui accélèrent sans sacrifier la qualité

Une fois la structure en place, la question de l’outillage devient secondaire — mais elle compte quand même pour tenir le rythme mensuel sans y passer trois jours.

GA4 reste la source centrale pour le trafic organique, les conversions et la segmentation. Couplé à Looker Studio, il permet de construire des dashboards dynamiques adaptés à chaque profil de lecteur — sans re-créer le rapport de zéro chaque mois.

Google Search Console s’exporte directement vers Google Sheets ou Looker Studio pour tout ce qui touche à la couverture, aux positions et au CTR. Les exports programmés automatisent la fraîcheur des données. Pour les workflows récurrents en agence, Zapier ou AppScript gèrent les notifications en cas de variations critiques.

Les limites des outils gratuits apparaissent vite dès qu’on monte en volume ou en complexité : suivi multi-sites, historisation longue durée, personnalisation avancée. Les solutions payantes s’imposent alors, mais uniquement si le gain de temps est réel.

Un point non négociable : l’automatisation ne remplace pas le regard humain. Aucun dashboard ne détecte seul qu’une chute de trafic est liée à une mise à jour Google et non à un bug technique. C’est cette lecture contextuelle qui justifie ton rôle. Pas le template.

Fréquence et timing : ne pas noyer le client

Le meilleur rythme est celui qui respecte deux contraintes simultanément : la fiabilité des données et la capacité d’attention du client.

Mensuel reste la norme. Mais attention au timing : publier un rapport le 1er du mois sur les données du mois précédent, c’est travailler sur des chiffres pas encore stabilisés. GA4 et la Search Console affichent un décalage de 3 à 5 jours. Attends. Les données seront plus fiables. Les conclusions aussi.

Pour les comptes matures ou saisonniers, croiser le mensuel avec un trimestriel permet de distinguer le bruit statistique de la tendance réelle. Les alertes ponctuelles — chute anormale de trafic, bug critique — viennent en complément, pas en substitut.

Multiplier les rapports hebdomadaires ?

Mauvaise idée.

On finit par surinterpréter des variations normales, faire des ajustements injustifiés, et fatiguer tout le monde. Le surreporting génère de la confusion, pas de la clarté.

La fréquence doit aussi évoluer avec la maturité du compte. Un projet en phase de lancement demande un suivi serré. Un compte stabilisé avec une équipe autonome peut fonctionner sur un rythme plus espacé et des échanges plus stratégiques.

Conclusion

Un rapport SEO mal construit ne fait pas que manquer sa cible. Il détériore la relation, crée de fausses urgences, et pousse parfois à des décisions qui vont à l’encontre de la stratégie. J’ai vu des comptes sains mis en danger par des rapports qui faisaient paniquer sur de mauvais signaux. Avant de te demander quel outil utiliser ou quelle métrique ajouter, pose-toi une seule question : est-ce que ce rapport permet à son destinataire de prendre une décision ? Si la réponse est non, le problème n’est pas technique. Chaque section doit avoir une utilité claire. Chaque métrique doit mener à une action possible. Le reste est du bruit. Commence par virer ce qui ne sert à rien — tu verras que le rapport devient déjà meilleur.

FAQ

Pourquoi les comparaisons concurrentielles ne sont pas au cœur du rapport ?

Parce qu’elles demandent une méthodologie de collecte rigoureuse que peu d’agences maîtrisent vraiment — et les biais introduits peuvent induire le client en erreur. Tant que la dynamique propre du site n’est pas stabilisée et lisible, se comparer aux autres revient à naviguer avec deux boussoles qui ne pointent pas dans la même direction. Concentre-toi d’abord sur tes propres marges de progression. La comparaison concurrentielle devient utile quand elle vient enrichir un pilotage déjà solide — pas le remplacer.