J’ai vu des dizaines de sites perdre des positions pour des raisons que n’importe quel outil d’audit technique SEO décent aurait détectées en dix minutes. Pas des erreurs complexes — des balises title dupliquées, des pages bloquées en crawl, des redirections en chaîne qui traînent depuis une migration ratée. Le problème, ce n’est pas l’absence d’outils. C’est le mauvais choix d’outil pour le bon contexte.

Le marché en propose des dizaines. Certains font tout, d’autres font une seule chose très bien. Et beaucoup de consultants finissent par en payer trois ou quatre sans vraiment exploiter aucun à fond. Avant de comparer les options, il vaut mieux comprendre ce qu’on attend réellement d’un audit technique — et ce que ces outils ne feront jamais à ta place.

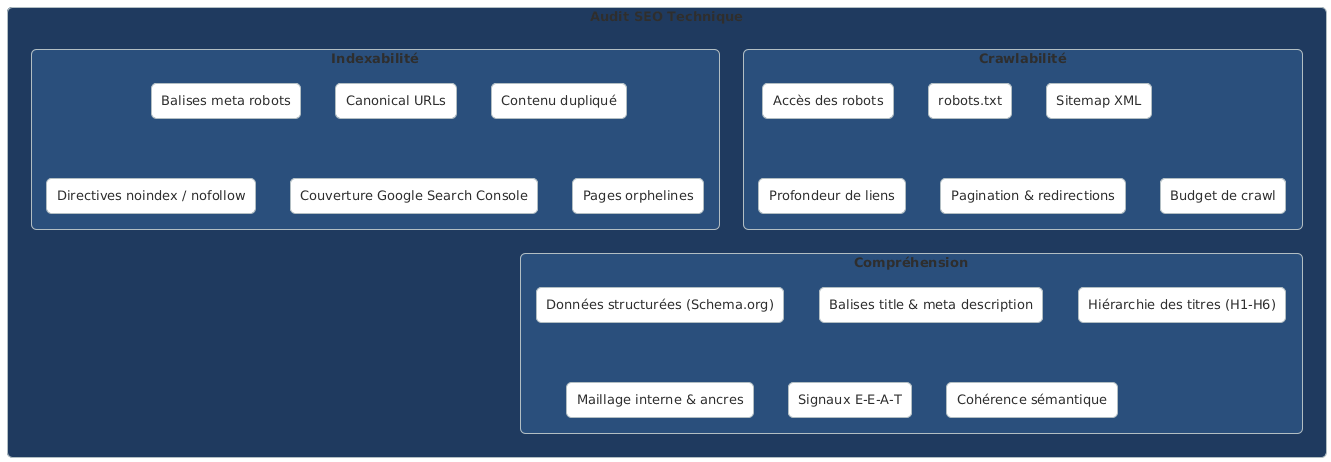

Ce qu’un audit technique couvre vraiment

On imagine souvent l’audit technique comme une liste de cases à cocher. En pratique, c’est rarement aussi propre.

Un audit technique SEO, c’est avant tout une lecture de la façon dont Google perçoit ton site : ce qu’il peut explorer, ce qu’il peut indexer, ce qu’il peut comprendre. Ces trois niveaux — crawlabilité, indexabilité, compréhension — ne posent pas les mêmes problèmes et ne nécessitent pas les mêmes outils.

La crawlabilité, c’est ce que le bot voit quand il arrive sur ton domaine. Les redirections, les erreurs 404, la profondeur de clic, le budget crawl. L’indexabilité, c’est ce que tu laisses entrer dans l’index : balises noindex, directives canoniques, contenu dupliqué. La compréhension, c’est plus subtil — données structurées, hiérarchie des titres, cohérence sémantique des pages.

Néanmoins, beaucoup d’outils se concentrent sur la couche crawl et traitent les deux autres en surface. C’est utile pour détecter les problèmes évidents, mais insuffisant si tu cherches à comprendre pourquoi une section entière d’un site stagne malgré un contenu correct.

Les trois catégories d’outils à connaître

Le bon outil dépend de ce que tu cherches, pas de ce qui est populaire sur Twitter.

Il y a trois familles distinctes, et les confondre coûte du temps — et parfois de l’argent.

Les crawlers autonomes — Screaming Frog, Sitebulb, Xenu pour les nostalgiques — explorent ton site comme le ferait Googlebot. Ils remontent les erreurs, les doublons, les redirections, les balises manquantes. Screaming Frog reste la référence pour les sites complexes, avec une flexibilité de configuration que peu d’outils égalent. Sitebulb est plus accessible visuellement, utile quand tu dois présenter un audit à un client non technique.

Les suites SEO intégrées — Semrush, Ahrefs, Moz — proposent un module d’audit dans un environnement plus large. L’avantage, c’est la corrélation : tu peux croiser les données techniques avec les performances organiques, les backlinks, les positions. L’inconvénient, c’est que leur crawler est moins fin qu’un outil dédié sur des sites très grands ou très complexes.

Les outils Google natifs — Search Console, PageSpeed Insights, Rich Results Test — sont souvent sous-utilisés. Par conséquent, des problèmes d’indexation réels, visibles directement dans les rapports de couverture, passent inaperçus pendant des semaines. Ces outils donnent la perspective de Google, pas une simulation. C’est une différence fondamentale.

Comparatif rapide des outils principaux

| Outil | Type | Points forts | Limites |

|---|---|---|---|

| Screaming Frog | Crawler | Précision, flexibilité, logs | Interface austère, courbe d’apprentissage |

| Sitebulb | Crawler | Visualisation, rapports clairs | Moins puissant sur très grands sites |

| Semrush | Suite intégrée | Corrélation données, suivi positions | Crawler moins fin que les dédiés |

| Ahrefs | Suite intégrée | Backlinks + technique combinés | Coût élevé, audit technique basique |

| Google Search Console | Natif Google | Données réelles d’indexation | Pas de simulation crawl externe |

| PageSpeed Insights | Natif Google | Core Web Vitals, données terrain | Limité à la performance, pas au crawl |

Ce que les outils ne feront pas à ta place

C’est là que beaucoup se trompent : un bon outil d’audit remonte des données, pas des décisions.

J’ai récupéré des audits générés automatiquement par des suites SEO qui affichaient 847 « erreurs critiques » — dont les trois quarts étaient soit du bruit, soit des faux positifs, soit des problèmes déjà connus et volontairement laissés en l’état. Le client pensait que son site était en ruine. Il n’avait en réalité que trois vrais problèmes à traiter.

En outre, la priorisation ne se fait pas dans l’outil, elle se fait dans ta tête. Un site e-commerce avec 50 000 pages en pagination non canonisée, c’est un problème différent d’un blog de 80 articles avec deux redirections cassées. Les deux peuvent générer des alertes rouge dans le même tableau de bord. Ce n’est pas l’outil qui sait lequel impacte le trafic.

La donnée brute a besoin d’une lecture métier. Est-ce que cette page dupliquée est un vrai problème ou une URL de session ? Est-ce que ce temps de chargement de 4 secondes concerne une page critique ou une page enterrée dans l’arborescence ? Ces questions, l’outil ne peut pas y répondre.

Comment choisir selon ton contexte

Néanmoins, il existe des repères concrets pour orienter le choix sans se perdre dans les comparatifs de fonctionnalités.

Si tu travailles seul sur des sites de taille moyenne, Screaming Frog en licence annuelle combiné à Search Console couvre 80% des besoins d’audit technique courants. C’est le duo le plus efficace en termes de rapport coût/profondeur.

Si tu travailles en agence ou sur des comptes où la visibilité globale compte — positions, backlinks, état technique — une suite comme Semrush ou Ahrefs fait sens. Par conséquent, tu centralises la lecture et tu gagnes du temps sur les reportings. Mais ne remplace pas le crawler dédié quand tu dois aller fin sur un site complexe.

Si tu audites des sites à fort volume — plusieurs centaines de milliers d’URLs — tu auras besoin de coupler un crawler avec une analyse des logs serveur. Screaming Frog permet l’import de logs directement. C’est une fonctionnalité sous-exploitée, pourtant décisive pour comprendre ce que Googlebot crawle réellement, pas ce qu’il devrait crawler en théorie.

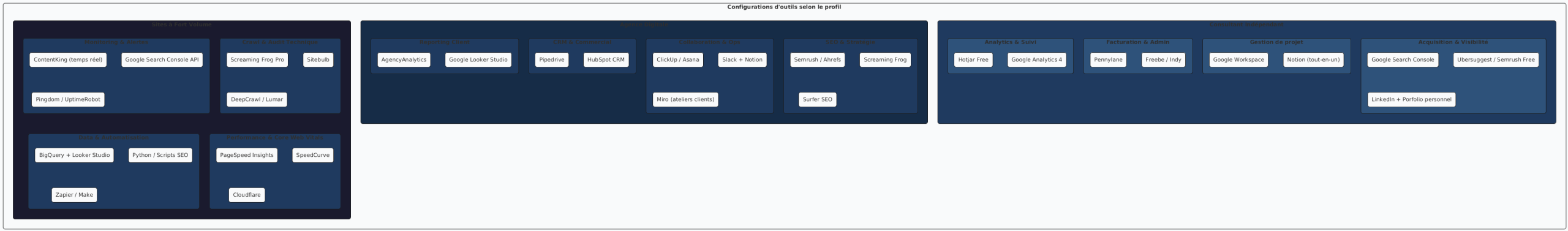

Voici les trois configurations les plus courantes selon le profil :

- Consultant indépendant / petits sites : Screaming Frog + Search Console + PageSpeed Insights

- Agence / portefeuille de clients : Semrush ou Ahrefs + Screaming Frog pour les audits approfondis

- Sites à fort volume / e-commerce : Screaming Frog + analyse logs + Search Console (rapports de couverture et d’exploration)

La Search Console reste sous-exploitée

C’est probablement l’outil le plus précieux et le moins bien utilisé du marché.

Les rapports de couverture d’index de la Search Console donnent une vue directe sur ce que Google a tenté d’indexer, ce qu’il a exclu et pourquoi. En outre, les rapports d’exploration — disponibles sur les propriétés vérifiées depuis un certain temps — montrent la fréquence de crawl, les erreurs rencontrées par Googlebot, et les types de contenu explorés. Aucun crawler tiers ne peut reproduire ça, parce que ces données viennent directement de Google.

J’ai vu des cas où Screaming Frog ne détectait aucun problème majeur, mais où Search Console remontait des milliers d’URLs exclues pour « contenu dupliqué ». Le crawler n’avait pas tort — le site était propre en apparence. Le problème venait de paramètres d’URL générés dynamiquement que le crawler n’avait pas parcourus. Seule la Search Console montrait ce que Google avait réellement vu.

C’est ça, la différence entre simuler un crawl et lire ce que le moteur a réellement fait.

Conclusion

Choisir un outil d’audit technique SEO, ce n’est pas chercher le plus complet ou le plus populaire. C’est identifier ce que tu dois voir, à quelle profondeur, et dans quel contexte.

Pour la majorité des situations, Screaming Frog et Search Console suffisent. Une suite intégrée apporte de la valeur quand tu as besoin de croiser les données techniques avec d’autres dimensions — mais elle ne remplace pas un crawler dédié quand la précision est requise.

Néanmoins, l’outil n’est pas le résultat. J’ai vu des audits produits avec les meilleurs outils du marché rester lettre morte parce que personne ne savait prioriser les correctifs. La Search Console est gratuite et sous-exploitée par la plupart. Commence là : ouvre le rapport de couverture, regarde ce que Google exclut, et demande-toi pourquoi avant d’investir dans quoi que ce soit d’autre.