Améliorer son SEO avec l’intelligence artificielle, ça ne ressemble pas à ce que les démos promettent. Tu automatises, tu publies, tu optimises. Et pourtant les positions stagnent. Parfois elles reculent. Le trafic généré par tes nouveaux contenus s’essouffle en quelques semaines. Ce n’est pas une malchance. Ce sont des erreurs structurelles, souvent invisibles, que l’IA installe discrètement dans ton dispositif quand elle n’est pas cadrée. J’ai vu cette séquence se répéter : l’outil impressionne, les métriques de production explosent, et six mois plus tard on cherche à comprendre pourquoi Google ne suit pas. La réponse est rarement dans l’outil. Elle est dans ce qu’on lui demande de faire — et dans ce qu’on croit qu’il fait tout seul.

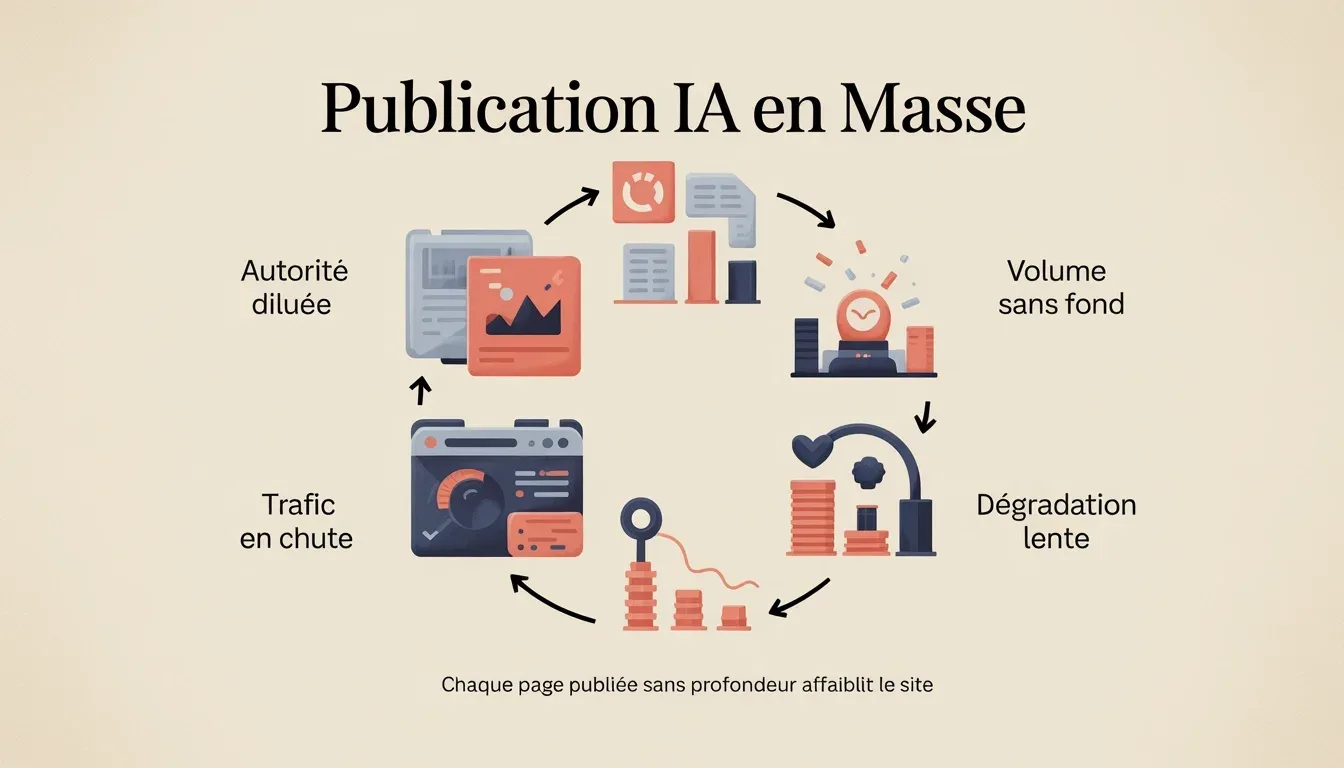

Pourquoi publier en masse avec l’IA détruit ta visibilité

Beaucoup d’équipes ont cru que le volume était la réponse. Publier vite, couvrir large, dominer les SERP par saturation. L’IA le permet. Google s’en est aperçu.

Depuis 2022, les mises à jour algorithmiques ciblent précisément les schémas de contenu produit en masse : formulations génériques, structures répétitives, absence d’ancrage réel. Le site qui multiplie les pages sans profondeur ne gagne pas en autorité — il dilue ce qu’il avait. J’ai vu des domaines perdre 30 à 40 % de leur trafic organique après des campagnes de publication IA non supervisées. Pas une pénalité manuelle. Une dégradation algorithmique progressive, difficile à inverser.

Le problème fondamental : un texte généré automatiquement manque d’ancrages contextuels. Pas d’exemple local, pas de référence sectorielle, pas de regard humain sur ce que cherche vraiment l’utilisateur.

Quantité permise par l’IA.

Qualité attendue par Google.

Ces deux courbes ne se croisent pas.

L’optimisation IA doit aller plus loin que la reformulation et le remplissage de mots-clés. Chaque page publiée doit montrer une valeur ajoutée nette face à la concurrence. Sinon, elle est invisible — ou pire, elle affaiblit les pages qui fonctionnaient déjà.

Ce que l’IA ne voit pas dans une recherche de mots-clés

Et pourtant, même en réduisant le volume, beaucoup d’équipes continuent de rater leur ciblage. Parce que le problème remonte plus haut : à la recherche de mots-clés elle-même.

Les outils IA excellent pour suggérer des clusters thématiques. Rapidement, proprement. Mais ils restent aveugles à l’intent réel. Ils traitent des volumes, pas des besoins. Un mot-clé à fort trafic peut masquer une intention d’achat, une demande de comparatif, une méfiance à dépasser — autant de signaux qu’une IA ne lit pas entre les lignes.

| Mot-clé suggéré par l’IA | Intent détecté par l’IA | Intent réel (analyse humaine) | Risque SEO |

|---|---|---|---|

| « Outil IA pour SEO » | Informatif | Comparatif + validation usage pro | Taux de rebond élevé |

| « Optimiser texte IA » | Informatif | Tutoriel personnalisé | Insatisfaction utilisateur |

| « SEO automatique 2026 » | Informatif | Évitement des pénalités, gestion du scaling | Perte de confiance |

Le volume n’égale pas la valeur.

L’IA liste.

Toi, tu contextualises.

Cartographier les intentions — informationnelle, transactionnelle, navigationnelle — reste un travail humain. Confronter chaque cluster à la SERP réelle, tester, ajuster : c’est là que se gagne ou se perd la pertinence d’un contenu.

Quand le machine learning amplifie tes erreurs plutôt que tes forces

Même avec un ciblage propre, l’automatisation peut dérailler si elle s’applique sur une architecture éditoriale bancale. Et c’est là que le machine learning devient dangereux.

Un modèle entraîné sur un site mal structuré reproduit ses incohérences. Il les accélère. Un e-commerce qui utilise l’IA pour optimiser ses fiches produit sans avoir clusterisé sa gamme peut générer jusqu’à 40 % de pages en cannibalisation interne — ses propres pages se concurrencent, l’autorité se fragmente, les money pages s’affaiblissent.

Avant d’automatiser quoi que ce soit, deux prérequis non négociables :

- Une architecture thématique claire : silos, hubs, clusters définis.

- Un mapping sémantique solide : entités, relations, attributs documentés.

Sans ça, l’IA ne produit pas de résultats. Elle produit de la duplication, du contenu orphelin, et des conflits internes.

L’apprentissage automatique est un multiplicateur.

S’il n’y a rien de solide à multiplier, il creuse plus vite le trou.

Moteurs génératifs : ce que ça change vraiment pour ton ranking

L’architecture est en ordre, le ciblage est affûté. Reste un changement de terrain que beaucoup sous-estiment encore : Google et ses concurrents ne renvoient plus simplement dix liens bleus.

Depuis l’intégration des réponses génératives dans les SERP, le CTR organique a chuté de 15 à 30 % sur certains segments à forte valeur (données indicatives, 2024). L’IA répond directement. L’utilisateur ne clique plus. Ou clique différemment.

La nouvelle logique : ne plus viser seulement la première position, mais être cité comme source de référence par le moteur lui-même. Ce qui implique un contenu structuré pour être « aspiré » : synthétique, sourcé, balisé avec des données structurées, FAQ, tableaux, définitions claires.

Être visible ne suffit plus.

Il faut être irremplaçable comme source.

Attention au revers : sur-optimiser pour les featured snippets avec des schémas génériques revient à offrir ta réponse à l’IA sans garder le trafic. Seuls les contenus qui apportent quelque chose qu’un modèle généraliste ne peut pas dupliquer — données propriétaires, études de cas chiffrées, expertise de terrain — maintiennent un potentiel d’acquisition réel.

L’IA optimise ton contenu et efface ta voix

C’est la dernière erreur. La plus silencieuse. Et souvent la plus coûteuse à corriger.

L’IA standardise bien. Elle respecte les guidelines, intègre les mots-clés, structure proprement. Mais elle lisse. Un contenu relu uniquement par un algorithme perd son style, son audace, sa singularité. Il ressemble à mille autres pages sur le même sujet.

J’ai observé ce pattern chez des sites media qui ont automatisé leurs éditos : gain de productivité immédiat, stagnation des backlinks naturels quelques trimestres plus tard. L’audience ne partage plus ce qui ne lui parle plus.

Le dwell time recule. Le taux de rebond remonte. La mémorisation de la marque s’efface.

Ce n’est pas un signal Google facile à détecter dans la Search Console. C’est une érosion lente, mesurable uniquement en regardant les bonnes métriques sur la durée.

Réintégrer la voix après optimisation IA, ça s’appelle l’édition humaine. Anecdotes, prises de position, références métier, une intro qui rompt le schéma habituel. Pas pour faire joli. Pour que le lecteur sente qu’un humain a réfléchi à ce qu’il lit.

L’homogénéisation est le vrai risque de l’industrialisation.

La spécificité, ton seul rempart contre la banalisation.

Conclusion

L’IA ne remplace pas la stratégie. Elle l’amplifie — dans les deux sens. Si le socle est solide, elle accélère. Si l’intent est mal défini, l’architecture bancale, la voix absente, elle aggrave les problèmes plus vite que tu ne les détecterais sans elle.

Ce que j’applique systématiquement avant tout déploiement IA : valider l’intention de chaque cible, auditer la structure thématique du site, documenter la voix éditoriale de la marque, tester sur un périmètre limité avant de scaler.

Ce n’est pas une checklist de prudence. C’est la condition pour que l’automatisation produise autre chose que du bruit.

L’IA peut devenir un vrai levier SEO. Mais seulement si tu gardes la main sur ce qu’elle ne sait pas faire seule.

Commence par auditer tes dix dernières pages générées par IA. Regarde leur trafic, leur taux de rebond, leur nombre de backlinks. La réponse sur l’état de ton dispositif est déjà là.

FAQ

Dois-je arrêter d’utiliser l’IA pour mon SEO ?

Non. Mais l’utiliser sans stratégie claire, c’est aller dans le mur plus vite. L’IA doit servir une direction, pas s’y substituer.

Quelle est la part idéale entre IA et travail manuel ?

Il n’existe pas de ratio universel. L’édition humaine reste incontournable dès qu’on touche à l’intent, à la voix ou à l’expertise de fond.

Comment savoir si Google a pénalisé mon contenu IA ?

Baisse brutale de trafic, pages qui disparaissent du top, alertes dans la Search Console. Ce sont les signaux les plus lisibles.

L’IA peut-elle anticiper les mises à jour d’algorithme ?

Elle détecte des tendances. Elle ne prédit rien. La veille humaine reste le seul moyen de s’adapter quand Google change les règles.