Tu as peut-être déjà vécu ça : un matin, tu ouvres Search Console et quelque chose ne va pas. Le trafic baisse, le classement glisse, et tu n’as rien changé. Un backlink toxique peut suffire à déclencher ce genre de signal — plusieurs, c’est une autre histoire. En quinze ans de SEO, j’ai vu des profils de liens propres se faire polluer en quelques semaines, parfois sans que personne ne s’en rende compte avant qu’il soit trop tard. La bonne nouvelle, c’est que le problème est gérable si tu sais quoi regarder — à condition, bien sur, de construire une stratégie de backlinks saine et durable qui évite d’en arriver là.. Cet article couvre ce qu’est réellement un lien toxique, comment le repérer avec méthode, et comment neutraliser son impact — sans tomber dans les erreurs classiques qui aggravent la situation au lieu de la régler.

Comprendre les backlinks toxiques : Définition et impacts SEO

On utilise le terme « toxique » un peu trop librement dans notre métier. Avant d’agir, encore faut-il savoir ce qu’on désavoue vraiment.

Définition et typologies

Un backlink toxique, c’est un lien entrant que Google interprète comme un signal de manipulation — pas simplement un lien de mauvaise qualité. La nuance compte. Un lien depuis un petit blog oublié n’est pas toxique par défaut. En revanche, un lien depuis un PBN monté pour vendre de l’autorité, ou depuis une ferme de liens avec des ancres commerciales répétitives comme « acheter X pas cher », ça, c’est un vrai problème.

Les typologies les plus fréquentes que je rencontre en audit :

- Sites sources sans trafic organique réel, souvent générés automatiquement, dans les niches adult, casino ou pharma

- Ancres sur-optimisées répétées sur des dizaines de domaines différents — c’est exactement ce que Penguin a commencé à pénaliser, et les Core Updates depuis 2024 ont renforcé ce filtre

- Liens en masse issus de commentaires de blogs automatisés, d’annuaires fantômes ou de forums sans modération

- Domaines référents qui n’ont aucun rapport thématique avec le site cible — un site de services juridiques qui reçoit des liens depuis des forums de jeux en ligne, par exemple

Signes typiques de toxicité

Ce qui rend la détection difficile, c’est que les signaux se cumulent rarement de façon évidente. Le score de toxicité affiché par les outils comme Semrush est une pondération de plusieurs variables : réputation du domaine source, type d’ancre, ratio liens entrants/sortants, historique de pénalités connues. Aucun signal isolé ne suffit à condamner un lien.

Un ratio anormal de liens sortants sur une page sans contenu substantiel — disons 80 liens sortants pour trois phrases — est un signal fort. Une explosion soudaine du nombre de domaines référents sur deux ou trois semaines, encore plus. Ce profil de croissance anormal est souvent la signature d’une attaque de Negative SEO ou d’un achat de liens mal dosé.

Impact SEO

Dans la pratique, les effets ne sont pas toujours immédiats. Google neutralise automatiquement une partie des liens problématiques, ce qui entretient l’idée que le désaveu serait devenu inutile. C’est faux — ou plutôt, c’est vrai jusqu’à un certain seuil. Quand la proportion de toxicité dépasse ce seuil critique, ou qu’une action manuelle est déclenchée, les conséquences deviennent concrètes : chute de positionnement sur des familles de mots-clés entières, érosion du trafic organique, perte d’autorité de domaine difficile à récupérer. Dans des cas extrêmes, j’ai vu des pages perdre leur indexation complète — temporairement, mais c’est suffisant pour faire des dégâts durables sur un site e-commerce en pleine période commerciale.

Méthodes de détection des liens toxiques

Comprendre l’impact ne change rien si on ne sait pas où regarder. La détection, c’est là que la majorité des webmasters perdent du temps.

Audit de liens : la démarche clé

Un audit sérieux commence par croiser plusieurs sources. Google Search Console donne une vue partielle — utile, mais incomplète. Les outils tiers comme Semrush, Ahrefs ou Majestic indexent des bases bien plus larges et permettent de cartographier l’ensemble du profil référent : domaines à faible autorité, correspondances suspectes entre ancres et pages cibles, clusters IP similaires qui trahissent des réseaux de liens.

La distinction entre un site victime de Negative SEO et un site ayant accumulé des liens douteux par négligence est importante. Les patterns ne sont pas les mêmes. Dans le premier cas, les liens arrivent vite, en masse, souvent depuis des domaines étrangers avec des ancres dans d’autres langues. Dans le second, la dégradation est progressive, moins visible, parfois héritée d’anciennes pratiques de netlinking.

Outils d’analyse : comparatif fonctionnel

Les deux références les plus utilisées pour l’audit de toxicité restent Semrush et Moz. Voici ce que j’observe concrètement sur leurs fonctionnalités en 2026 :

| Fonction | Semrush | Moz |

|---|---|---|

| Score de toxicité | Oui (Toxic Score avancé, multi-signaux) | Oui (Spam Score) |

| Analyse des ancres | Approfondie | Approfondie |

| Suggestions de désaveu | Oui (liste exportable, pré-assemblée) | Oui (moins granulaire) |

| Détection de patterns | IA propriétaire avancée | Clustering thématique |

| Rapports programmés | Oui | Oui |

| Prix 2026 | À partir de 119 $/mois | À partir de 99 $/mois |

Semrush va plus loin dans la granularité du Toxic Score — il croise des dizaines de signaux et génère des alertes contextualisées. Son module de désaveu pré-assemble les liens suspects pour accélérer la validation humaine. Moz est plus accessible pour des équipes moins expérimentées, avec un Spam Score lisible et une présentation pédagogique. Pour un profil complexe ou un gros site, je préfère Semrush. Pour un audit ponctuel sur un site de taille modeste, Moz fait largement le travail.

Limites des outils et nécessité d’une revue humaine

Aucun outil ne fait la distinction entre un vieux forum thématique encore actif et un forum spam. C’est l’humain qui tranche. J’ai vu des liens légitimes — citations de marque sur des plateformes atypiques, mentions éditoriales sur des sites à faible DA — se retrouver dans des listes de désaveu préparées automatiquement. Désavouer ces liens, c’est se tirer une balle dans le pied. D’où l’importance de croiser les sources (Search Console + plusieurs outils) et de valider manuellement avant d’agir. Un lien récent dissimulé via du cloaking peut aussi passer sous les radars temporairement — les bases d’index ne sont jamais exhaustives en temps réel.

Un e-commerce que j’ai audité avait subi une attaque Negative SEO classique : 800+ liens apparus en trois semaines, majoritairement depuis des domaines en cyrillique avec des ancres répétitives traduites par « acheter pas cher ». Le score de toxicité Semrush avait bondi, les positions avaient commencé à glisser sur les requêtes principales. Après vérification manuelle, les liens suspects ont été isolés et un fichier de désaveu préparé. Sans audit régulier, l’attaque aurait continué sans détection pendant des mois.

Stratégies de suppression et de désaveu des backlinks toxiques

Détecter ne suffit pas — encore faut-il agir dans le bon ordre, sans sur-réagir.

Suppression manuelle des liens

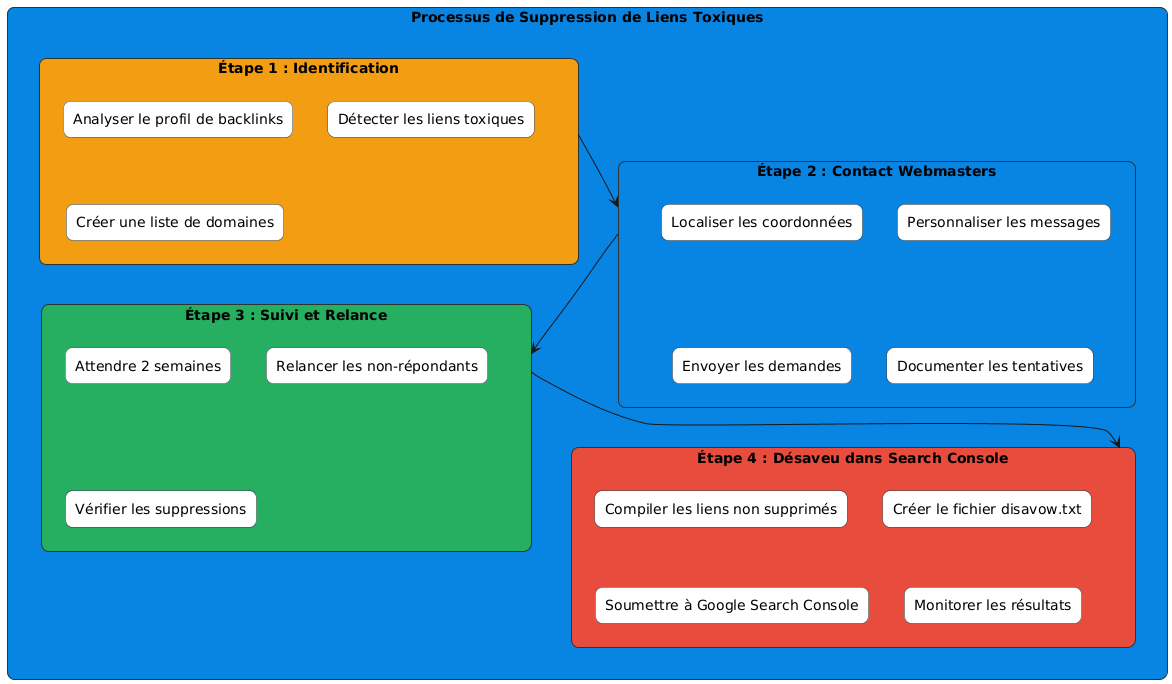

Avant d’aller sur l’outil de désaveu, il faut tenter la suppression directe. Contacter le propriétaire du site source reste la démarche la plus propre — et parfois, ça fonctionne. Un webmaster actif qui ne réalise pas que son site a servi de base à un réseau de liens va souvent retirer le lien rapidement s’il comprend le problème.

La démarche tient en quatre points :

- Identifier précisément l’URL du lien et la page cible associée

- Rédiger une demande courte, courtoise, sans ton accusateur

- Relancer sous dix jours si aucune réponse

- Archiver tous les échanges — c’est utile en cas de pénalité manuelle et de recours ultérieur

Sur les plateformes abandonnées ou les domaines expirés rachetés pour faire du spam, inutile d’insister. Le désaveu est la seule issue.

Processus de désaveu Google : entre mythes et réalités

Le désaveu est souvent mal compris, dans les deux sens. Certains l’évitent par peur de toucher à quelque chose de complexe. D’autres l’utilisent de façon préventive en désavouant des liens qui ne posent aucun problème réel — c’est une erreur qui peut dégrader le signal d’autorité naturelle du site.

Le process lui-même est simple : un fichier .txt structuré selon la syntaxe Google, soumis via https://search.google.com/search-console/disavow-links. Le traitement initial prend environ 48 heures, mais le recrawl complet et l’effet concret sur les positions peuvent prendre entre quatre et six mois. Il faut s’y préparer mentalement — il n’y a pas de retour immédiat et visible.

Ce que le désaveu ne fait pas : il ne supprime pas le lien du web. Il neutralise algorithmiquement son influence sur l’autorité du site cible. Le lien reste là, mais Google l’ignore dans ses calculs. C’est suffisant dans la plupart des cas.

Le risque principal, c’est le désaveu trop large. Inclure des domaines légitimes dans le fichier — même par erreur — peut altérer le profil de liens naturels et envoyer un mauvais signal global. Chaque soumission doit être précédée d’une revue manuelle sérieuse.

Optimiser le suivi post-désaveu

Après soumission, il ne se passe rien de visible pendant plusieurs semaines — c’est normal. Programmer un audit complet 30 à 45 jours après permet de vérifier si le score de toxicité a baissé et si la courbe de trafic commence à se stabiliser. Google ne confirme pas la prise en compte du désaveu sauf dans les cas de pénalité manuelle, où un message de levée de sanction peut apparaître dans Search Console.

La règle que j’applique : un audit de profil de liens tous les trimestres minimum. Les attaques Negative SEO peuvent se déclencher n’importe quand, pas seulement lors d’une phase concurrentielle intense.

Conclusion

Gérer les backlinks toxiques, ce n’est pas une action ponctuelle qu’on fait une fois lors d’une chute de trafic. C’est une surveillance régulière, avec un process clair : audit trimestriel, validation humaine avant tout désaveu, suppression directe d’abord quand c’est possible. Les outils aident à voir vite et large, mais c’est le jugement humain qui évite les erreurs coûteuses — désavouer un lien légitime ou ignorer une attaque en cours parce que le score de toxicité n’a pas encore bougé. En 2026, Google neutralise plus de signaux de manipulation qu’avant, mais ça ne remplace pas la diligence du webmaster. Un profil de liens propre se construit sur la durée et se défend avec méthode. Lance un audit de ton profil référent cette semaine — pas dans six mois quand le trafic aura déjà chuté.

FAQ

Quelle est la politique de Google sur les liens indésirables en 2026 ?

Google maintient une position ferme contre la manipulation par liens. Les algorithmes neutralisent automatiquement une partie des liens suspects, mais la responsabilité de détecter et désavouer les liens réellement nuisibles reste du côté du webmaster. Se reposer entièrement sur la neutralisation automatique, c’est prendre un risque que rien ne justifie quand les outils d’audit sont accessibles et fiables.